Seçiləni silin

Bu şərhi silmək istədiyinizdən əminsiniz?

Seçiləni silin

Bu şərhi silmək istədiyinizdən əminsiniz?

Seçiləni silin

Bu şərhi silmək istədiyinizdən əminsiniz?

Şikayət et

Bu şərhi şikayət etmək istədiyinizdən əminsiniz?

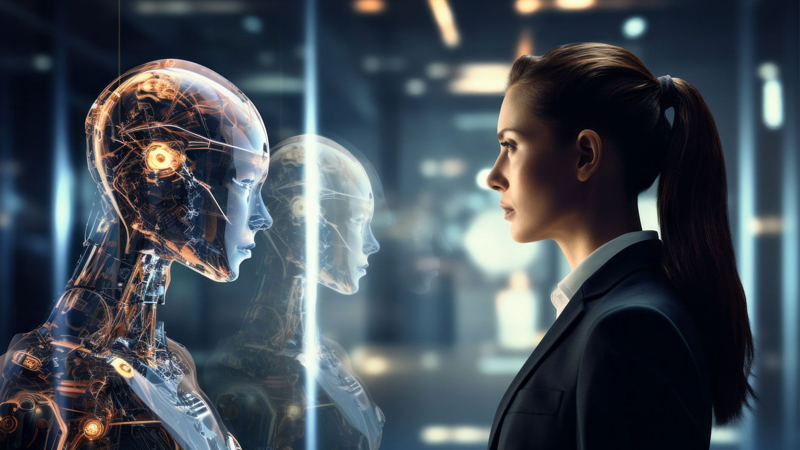

Trend olan süni intellekt fotolarımız - Əyləncə, yoxsa risk?

Son günlər sosial şəbəkələrdə yeni bir trend sürətlə yayılır. İnsanlar süni intellekt, xüsusilə ChatGPT-yə şəxsi fotolarını hazırladır. Bu gün hər iki istifadəçidən birinin sosial şəbəkə hesabında belə hazırlanmış fotolara rast gəlmək olar. Belə ki, istifadəçilər öz şəkillərini və ixtisasları, maraq dairələri, həyat tərzi barədə məlumatları ilə birgə platformaya yükləyərək, həmin məlumatlar əsasında fərqli üslubda fotolar hazırlamasını istəyirlər.

Cəlbedici görünən bu trend eyni zamanda rəqəmsal təhlükəsizliklə də bağlı suallar yaradır.

Bəzi şəxslər düşünür ki, şəxsi məlumatlarımızın süni intellekt platformalarına ötürülməsi hansısa risklər yarada bilər.

Mövzu ilə bağlı Qaynarinfo-ya açıqlama verən İKT eksperti Elvin Abbasov bildirib ki, bu trend vizual olaraq maraqlı görünsə də, süni intellekt platformalarına şəxsi fotoların və həyat detallarının ötürülməsi ciddi rəqəmsal təhlükəsizlik riskləri yaradır:

"Şəkil platformaya yüklənən zaman sistem təkcə karikatura və ya dizayn hazırlamır, eyni zamanda istifadəçinin üz cizgilərinin biometrik xəritəsini formalaşdırır. Bu isə gələcəkdə "deepfake” kimi saxta kontentlərin yaradılmasında və ya süni intellekt modellərinin təlim prosesində istifadə oluna bilər".

Ekspert vurğulayır ki, şifrəni dəyişmək mümkün olsa da, biometrik məlumatlar (üz cizgiləri) ömürlükdür və bir dəfə sızdıqda geri bərpa edilməsi qeyri-mümkündür.

"Bu məlumatlara üçüncü tərəflərin çıxış imkanı varmı" sualına cavab olaraq Elvin Abbasov qeyd edib ki, belə risk hər zaman var:

"Üçüncü tərəflərin bu məlumatlara çıxış imkanı isə platformanın biznes tərəfdaşları, bulud saxlama xidmətləri və ya kiber-hücumlar vasitəsilə hər zaman mövcuddur".

Elvin Abbasov əlavə edib ki, şirkətlər məlumatları çox zaman "anonimləşdirilmiş” formada istifadə etdiklərini bildirsələr də, haker hücumları və ya məlumat bazalarının sızması nəticəsində şəxsi arxivlər "qara bazar”ın hədəfinə çevrilə bilər:

"Rəqəmsal təhlükəsizliyin əsas prinsipi minimum məlumat paylaşmaqdır. Həmçinin istifadəçilərə tətbiqlərin tənzimləmələrində "məlumatların təlim üçün istifadəsi” (data training) funksiyasını deaktiv etmək tövsiyə olunur".

Günay İlqarqızı

Oxşar xəbərlər

Bloqlar

Pozitiv dünyadan çıx

Pozitiv dünyadan çıxmaq istədiyinizdən əminsiniz?

Xəbərdarlıq

DİQQƏT! Qaynarinfo.az-ın açıq materiallarının olduğu kimi surətini çıxarmaq, digər saytlara yerləşdirmək, yaymaq qadağandır. Qanunvericiliyə əsasən açıq materialların yalnız 1/3 hissəsindən istifadə etmək olar. Əks halda məsələ məhkəmə predmeti ola bilər!

Şərhlər